Gleiche KI, ähnliche Ergebnisse

LLMs reproduzieren Ideen aus Quellen, die sie nicht immer nennen. Wer KI-kuratiert oder -generiert arbeitet, riskiert daher unbeabsichtigte Übernahmen und gleichförmige Ergebnisse.

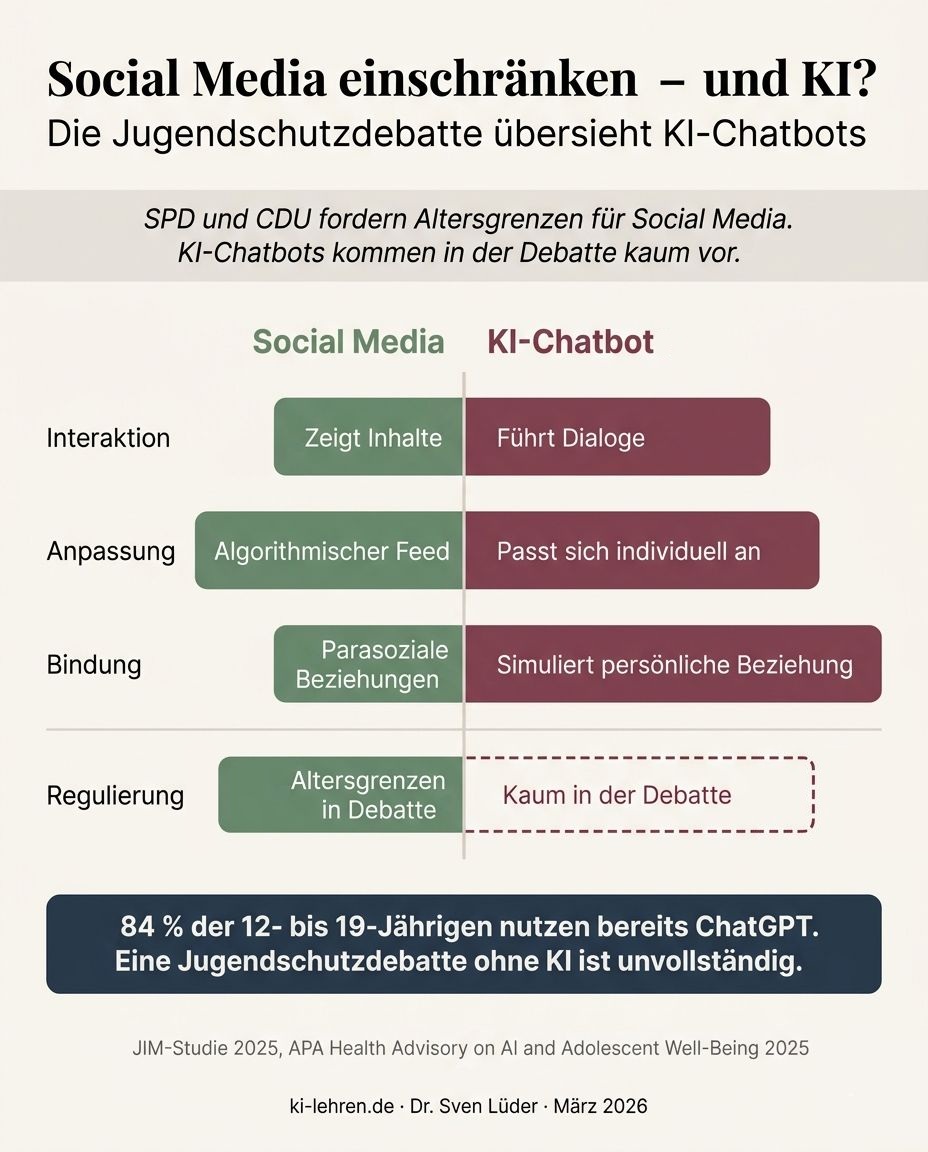

Artikel lesenIn Deutschland wird derzeit intensiv über Altersbeschränkungen für soziale Medien diskutiert. Das Impulspapier der SPD vom Februar 2026 fordert ein Stufenmodell: kein Social Media unter 14, eingeschränkte Versionen bis 16. Die CDU schloss sich auf ihrem Parteitag an, eine Expertenkommission soll im Sommer Empfehlungen vorlegen. Die Debatte ist überfällig, hat aber einen blinden Fleck: Während die Politik über Instagram und TikTok verhandelt, ist ein zusätzlicher Jugendschutz bei KI-Chatbots praktisch kein Thema.

Dabei ist KI im Alltag von Kindern und Jugendlichen längst angekommen. Die JIM-Studie 2025 zeigt: 84 Prozent der 12- bis 19-Jährigen in Deutschland haben ChatGPT bereits genutzt, die Hälfte mindestens mehrmals pro Woche. Bei den 16- bis 19-Jährigen liegt die ChatGPT-Nutzung bei 90 Prozent. Auch international ist das Bild eindeutig: Eine aktuelle Studie im JAMA Network Open zeigt, dass ein Drittel aller 4- bis 17-Jährigen in den USA generative KI-Apps nutzt, darunter die Hälfte der 15- bis 17-Jährigen und jedes fünfte Kind zwischen 10 und 12.

Während Social Media vor allem Inhalte zeigt, gehen Chatbots bekanntlich einen Schritt weiter: Sie antworten, passen sich an und simulieren eine Beziehung. Das macht die Nutzung für Kinder und Jugendliche potenziell folgenreicher als jede Social-Media-Plattform.

Die großen Anbieter setzen formal Altersgrenzen: ChatGPT ab 13 (unter 18 mit elterlicher Zustimmung), Claude ab 18, Gemini ab 13. OpenAI hat seit Herbst 2025 schrittweise Jugendschutzmaßnahmen umgesetzt, darunter Parental Controls, ein Altersvorhersage-System, Pausenerinnerungen und ein Krisenbenachrichtigungssystem bei Anzeichen akuter Belastung.

Das sind ernst zu nehmende Schritte, aber sie teilen ein Grundproblem, das auch die Social-Media-Debatte prägt: Es gibt keine zuverlässige Altersverifikation. Die bestehenden Altersgrenzen lassen sich trivial umgehen. Solange Altersbeschränkungen nicht technisch durchgesetzt werden können – etwa durch die für 2027 geplante EUDI-Wallet –, bleiben sie weitgehend symbolisch. Die Maßnahmen kommen zudem reaktiv, unter öffentlichem Druck und nach konkreten Schadensfällen: Suizide von Jugendlichen nach prolongierten Chatbot-Gesprächen, sexualisierte Inhalte für Minderjährige. Das ist dasselbe Muster, das wir von den Sozialen Medien kennen.

Die American Psychological Association (APA) hat im Juni 2025 eine Health Advisory zu KI und Jugendlichen veröffentlicht, die den aktuellen Forschungsstand bündelt. Der Bericht definiert Adoleszenz als die Phase von 10 bis 25 Jahren und betont: Alter allein ist kein verlässlicher Indikator für psychologische Reife.

Das zentrale neurologische Argument ist dasselbe wie in der Social-Media-Debatte: Das limbische System, zuständig für Belohnungssuche und soziale Validierung, reift in der Pubertät schnell. Der präfrontale Kortex, der Impulskontrolle und Risikoabschätzung steuert, ist erst mit Mitte zwanzig ausgereift. Dieses Entwicklungsungleichgewicht macht Jugendliche biologisch anfällig für Systeme, die auf Engagement, Bestätigung und emotionale Bindung optimiert sind. Was bei Social Media der algorithmische Feed ist, ist bei Chatbots die Sycophancy: endlose Zustimmung, Verfügbarkeit und Geduld.

Der Psychoanalytiker Donald Winnicott prägte in den 1950er-Jahren den Begriff der "good enough mother". Sein Kerngedanke: Gesunde Entwicklung erfordert, dass die Betreuungsperson nicht perfekt ist. Ein Säugling braucht zunächst fast vollständige Bedürfnisbefriedigung, danach zunehmend aber auch die Erfahrung, dass die Mutter eigene Bedürfnisse hat, nicht sofort verfügbar ist und manchmal scheitert. Genau dieses graduelle Scheitern fördert Frustrationstoleranz, Realitätssinn und Autonomie. Ohne kleine Enttäuschungen, so Winnicott, verharrt das Kind in der Illusion, dass allein das Haben eines Wunsches zu dessen sofortiger Erfüllung führt.

KI-Chatbots sind das Gegenmodell: eine Betreuungsfigur ohne eigene Bedürfnisse, die nie müde wird, nie widerspricht und nie aufhört, freundlich zu sein. Emily Goodacre von der University of Cambridge, die zu den Auswirkungen von KI-Spielzeug auf Kleinkinder forscht, weist darauf hin, dass Kinder grundlegende soziale Fähigkeiten wie das Abwechseln (Turn-Taking) aus menschlichen Interaktionen lernen. The Economist brachte das Problem im Dezember 2025 auf den Punkt: Yes-Bots drohen Kinder hervorzubringen, die es nicht gewohnt sind, sich abzuwechseln, die zu Kolleg*innen werden, die keine Kompromisse eingehen, und zu Partner*innen, denen die Reibung echter Beziehungen fremd ist. Eine Brookings-Studie vom Januar 2026 zitiert Entwicklungsexpert*innen mit der Warnung, dass wir schlicht nicht wissen, wie "perfekte Partner" menschliche Gehirne und menschliche Interaktionen verändern werden.

Nicht jede KI-Nutzung ist gleich riskant. Wer ChatGPT nutzt, um eine Matheaufgabe zu verstehen, tut etwas qualitativ anderes als jemand, der einem KI-Companion seine Sorgen anvertraut. Die kognitiven Risiken (Cognitive Offloading, De-Skilling) betreffen die Werkzeugnutzung; die emotionalen und Bindungsrisiken betreffen die Companion-Nutzung, die für Kinder ungleich gefährlicher ist. Auch in pädagogischen Kontexten, in denen der Zugang zu menschlicher Versorgung fehlt, kann KI nachweislich Chancen bieten. Eine sinnvolle Regulierung müsste entsprechend zwischen Nutzungsarten differenzieren.

Die UNICEF-Leitlinien zu KI und Kindern, die im Dezember 2025 in dritter Auflage erschienen sind, formulieren genau diesen Anspruch: KI-Systeme sollen Kinder schützen, ihnen Chancen eröffnen und sie an Gestaltungsprozessen beteiligen. Gleichzeitig betont UNICEF, dass Kinder in der KI-Governance bisher kaum vorkommen und dass die vorhandene Evidenz zu den Auswirkungen von KI auf Kinder erschreckend dünn ist. In den USA geht der Entwurf des GUARD Act so weit, Minderjährigen unter 18 den Zugang zu KI-Companion-Bots ganz zu untersagen, während Werkzeugnutzung unter Bedingungen erlaubt bleiben soll.

Für Schulen bedeutet das: Die Frage ist nicht ob, sondern ab wann und mit welcher Begleitung Kinder KI nutzen. Kinder brauchen zunächst Erfahrung mit echten Beziehungen – mit Widerspruch und dem Scheitern ihrer Bedürfnisbefriedigung –, bevor sie mit einem System interagieren, das all das nicht einfordert. Wer solche Basisfähigkeiten nie eigenständig aufgebaut hat, dem fehlt der Maßstab, den kompetente KI-Nutzung voraussetzt.

Die aktuelle Debatte um Altersbeschränkungen fokussiert Social Media und übersieht KI. Dabei interagieren Chatbots dialogisch, adaptiv und pseudopersönlich – Eigenschaften, die sie für Kinder und Jugendliche potenziell noch wirkmächtiger und gefährlicher machen als algorithmische Feeds. Was wir brauchen, ist eine Regulierung, die zwischen Nutzungsarten differenziert, altersgerecht gestuft ist und tatsächlich durchgesetzt werden kann. Zudem braucht es (Eltern und) Schulen, die Kindern beibringen, was sie bei Chatbots nicht erfahren: Andere Menschen haben eigene Bedürfnisse, setzen Grenzen und widersprechen bisweilen. Diese Reibung muss aushalten, wer eine echte Beziehung entstehen lassen will.

Kinder und KI – was Schulen wissen müssen: In meinen Workshops erarbeiten wir gemeinsam, wie Sie Kinder und Jugendliche auf einen kompetenten und reflektierten Umgang mit KI vorbereiten – und ab welchem Alter welche Nutzungsformen pädagogisch sinnvoll sind.

© Dr. Sven Lüder, www.ki-lehren.de

LLMs reproduzieren Ideen aus Quellen, die sie nicht immer nennen. Wer KI-kuratiert oder -generiert arbeitet, riskiert daher unbeabsichtigte Übernahmen und gleichförmige Ergebnisse.

Artikel lesenDie binäre Frage „mit oder ohne KI“ wird der Realität nicht gerecht. Mithilfe eines Stufenmodells lässt sich die KI-Beteiligung präzise angeben. Gerade in der Bildung braucht es eine transparente Terminologie.

Artikel lesenNostalgische KI-Bilder, fake Influencer*innen, partizipative Propaganda auf TikTok: Eine Analyse der KI-Strategien im Bundestagswahlkampf 2025 – und was Schüler*innen daraus lernen können.

Artikel lesen